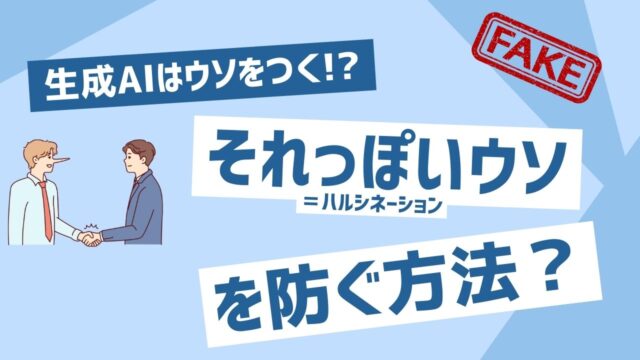

生成AIは使えない?活用拡大を阻む “それっぽいウソ” が起こる原因

生成AIを活用して社内DXを成功させたい!とお考えの方へ

- ChatGPTを少し触ってみたけど、デタラメが多くて使い物にならなかった…

- ウチの会社でも生成AI活用を検討したいけど、実際に使えるか不安…

こんな悩みはありませんか?

この記事では、生成AI活用を検討する際にネックになる“それっぽいウソ”を生成してしまう原因と、その対策方法について、できるだけ専門用語を使わずに噛み砕いて解説していきます。

また、記事の後半では無料で専門家に相談できる「オンライン壁打ち会」についてもご紹介しています。実際にプロジェクトを進める際の具体的な手法や、弊社nonet 株式会社のサポート内容についても触れています。

似たような悩みをお持ちの方は、ぜひ参考にしてみてください。

- 生成AIのハルシネーション問題について理解できる

- ハルシネーション対策としてRAGの活用方法を知る

- 生成AI導入をスモールスタートさせる方法がわかる

生成AIの現在地と、活用拡大に向けた課題

2022年の11月下旬、OpenAIより発表されてからほんの2ヶ月で利用者が1億人を突破(!)するという、私たちのこれまでの常識では考えられない速度で進化しています。

ビジネス利用の視点ではどうでしょうか。

テキスト生成AIの機能だけを切り出してみると、やはり人間による品質チェックは必要ですが 仕事の成果物として納品可能なレベルまでクオリティが向上しつつあります。

日本国内でも少しづつ生成AIの成功事例が紙面を賑わせる日も増えており、産業革命期の機械、IT革命期のインターネット、SNSバブル期のソーシャルメディアのように、今後数年で生成AIを活用した新しい働き方がよりスタンダードになっていくだろうと思われます。

しかし、その一方で。一部の現場からは「生成AIは使えない…」「最初の頃は利用していたけど、今では使わなくなってしまった…」という声が上がっているのも事実です。

生成AI活用を拡大する上での課題のひとつには、“ハルシネーション”と呼ばれる “それっぽいウソ” があるのですが…

■【関連記事】OpenAIがオススメする、ChatGPTを上手に活用する6つのコツ

生成AIが “それっぽいウソ” が生成してしまうワケ

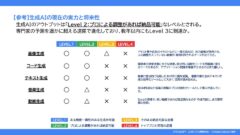

“それっぽいウソ”(=ハルシネーション)が生成される理由を理解するには、生成AIの基本的な仕組みについて知っておく必要があります。(画像クリックで拡大)

“それっぽいウソ”(=ハルシネーション)が生成される理由を理解するには、生成AIの基本的な仕組みについて知っておく必要があります。(画像クリックで拡大)

ChatGPTやGemini などのテキスト生成AIは、インターネットなどから収集した大量のデータを学習しており、この大量の学習データから、次に出現する確率が高い単語を予測(これをLLMといいます)しています。

つまり…生成AIは必ずしも「事実」を生成するわけではなく「出現確率の高い単語」を生成しているに過ぎない、という点に注意が必要です。学習モデルに十分な学習情報がない場合、それっぽいウソ(ハルシネーション)を生成することになってしまうわけですね。

しかし日本文化に関する学習データが不正確なのか、めちゃくちゃデタラメな嘘をつかれて悲しい気持ちになった経験があります泣

というわけで、そこの古代史お好きな方、私とツイッターで繋がって歴史ロマンを語り合いましょう!

“それっぽいウソ” を防ぐには”RAG” を考えてみよう

この”それっぽいウソ”(=ハルシネーション)ですが、生成AIのビジネス利用を真剣に考える上で対策を考えておく必要があります。

この”それっぽいウソ”(=ハルシネーション)ですが、生成AIのビジネス利用を真剣に考える上で対策を考えておく必要があります。

“それっぽいウソ”って…人間で例えるなら「知ったかぶり」みたいなものですから、予期せぬトラブルに繋がりかねません。

この予防策として注目を集めているのが、検索拡張生成などとも呼ばれている”RAG(Retrieval-Augmented Generation)“の技術です。

RAGは、教科書的にいうと「外部データベースから関連する情報を取得して、そのデータを基にテキスト生成を行う技術」です。

これは人間が本を読むことで知識を得て、仕事に活かすプロセスによく似ています。

未経験な業務分野について商談でうまく話ができない(ハルシネーション)ことを課題に感じて、大量の本(外部のデータベース)を取り込み、その中から必要な部分を見つけて自分の知識としてまとめ上げ、業務に活用(テキスト生成)する…

というイメージでしょうか。

RAG導入が思うように進まない2つの理由

生成AIを活用する上では “それっぽいウソ” への対策が必要なこと、そしてその対策技術として注目されているのRAGの技術とは何か?についてお伝えしてきました。

生成AIを活用する上では “それっぽいウソ” への対策が必要なこと、そしてその対策技術として注目されているのRAGの技術とは何か?についてお伝えしてきました。

ところが実際にRAGの導入を目指していく中で直面しがちな2つの課題があります。

- ノウハウを持つ人材がいない

- 学習データの品質をどのように確保するか

というものです。

理由1:知見・ノウハウを持つ人材が不足している

やはり最初に挙がるのが「専門知識・ノウハウを持つ人材を確保することの難しさ」でしょう。

やはり最初に挙がるのが「専門知識・ノウハウを持つ人材を確保することの難しさ」でしょう。

そもそも、生成AIというテーマ自体が注目され始めて間もないこともあり、さらにRAG導入を目指すとなると、十分な知見・ノウハウを持つ人材を確保するのは難しい実状があります。

特に限られた社内リソースの中ではAIの専門家を育成するのが難しく、結果として社内での知見が増えないためプロジェクトの進捗も思わしくない….というご相談が増えています。

組織マネジメントとして生成AI導入にコミットするには、専門部署を設置したり、”AI活用のためのプロジェクトチーム”を立ち上げることですが、限られた社内リソースでプロジェクトを進めるという制約がある場合、スモールスタートで成果早出を目指す、という座組みでスタートするケースも少なくありません。

理由2:学習データの品質を管理する仕組みが不十分

また、学習データの品質管理という課題についてはどうでしょうか。

また、学習データの品質管理という課題についてはどうでしょうか。

当記事のテーマでもある”それっぽいウソ”を撲滅するためには、学習に使用されるデータ自体が正確で偏りがないものである必要があります。

しかし、多くの企業は大量のデータを持っているものの、その中には古い情報や誤ったデータが含まれていることが少なくなく、AIが誤った結論を導き出すリスクが高まってしまいます。

最もシンプルかつ効果が高い方法として、信頼性の高いデータをRAG対象として選定する方法があります。当然ですが、データの品質はその出所に大きく依存します。

■【関連記事】事例やユースケースを元に、中小企業が生成AIを活用する最適解について考える

失敗を避けて、生成AIの活用を促すには?

- “生成AI知見”と”プロジェクト推進ノウハウ”を持つ人材の確保

- 成果に直結しやすい、生成AI活用の”対象選定”

という課題が見えてきます。

ここまでお伝えすると「社内のリソースだけで対応するのは難しそう…」と感じられた方もいらっしゃるでしょうか。

そのような場合は、弊社のようなパートナー企業を活用いただくのがオススメです。(完全なポジショントークではあります笑)

Google Cloudを活用したDXコンサルティングを提供しているnonet 株式会社では、御社の生成AIへの期待値・理解度に合わせて次のようなサービスを提供しています。

- 生成AIの基礎レクチャー、成功事例から考える自社活用ワークショップ

- SaaS(月額課金型)の生成AIエージェント提供

- 社内に眠るデータを活用するシステム(RAG)構築

※ちなみに今回ご紹介した記事の内容は「社内に眠るデータを活用するシステム(RAG)構築」メニューでのご提供となります。

また企画・検討段階の方にお役立て頂ける仕組みとして、毎月3社限定で「無料オンライン壁打ち会」にて、壁打ちベースでご相談いただける枠を設けております。

当記事の事例について詳しく話を聞きたい…これから生成AI活用について考え始めたいけど、具体的な検討はこれから…という方は、せっかくのこの機会をぜひご活用ください。

Seeds4biz〜”ビジネスのタネ”がみつかるメディア〜では、

小さな会社に役立つ「デジタル化・DX化」「業務改善」「マーケティング」といったテーマを中心に幅広い情報を発信しています。起業準備中・新規事業やりたい系の人も見てね。